霍金的人工智能警示 在數(shù)據(jù)海洋中航行,需謹慎掌舵

著名物理學家斯蒂芬·霍金曾多次在公開場合表達對人工智能(AI)發(fā)展的深切憂慮,他警告說,AI可能成為“人類歷史上最糟糕的事件”,若不加控制,或?qū)⒊饺祟愔悄懿⒆罱K威脅人類自身。這一預言在AI技術日新月異的今天,尤其是隨著公共數(shù)據(jù)資源的爆炸式增長,顯得尤為引人深思。

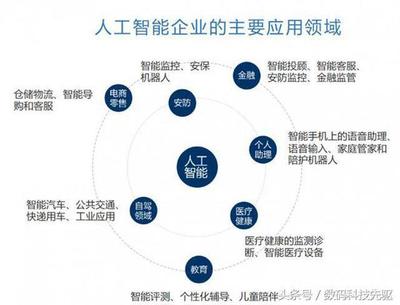

霍金的擔憂并非空穴來風。人工智能的進步高度依賴數(shù)據(jù),而公共數(shù)據(jù)作為其中最重要的“燃料”,正在驅(qū)動著從醫(yī)療診斷到自動駕駛、從金融分析到社交媒體的全面智能化。公共數(shù)據(jù)的開放性和龐大規(guī)模也帶來了雙重挑戰(zhàn):一方面,它加速了AI模型的訓練與優(yōu)化,使AI能夠更好地服務于社會;另一方面,數(shù)據(jù)中的偏見、隱私泄露風險以及算法的不透明性,可能導致AI系統(tǒng)產(chǎn)生不可預測的后果,甚至被惡意利用。

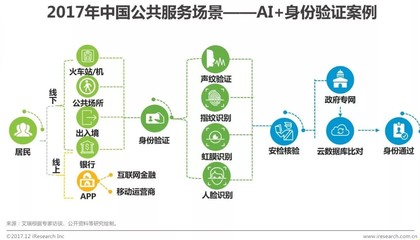

具體而言,公共數(shù)據(jù)可能隱含社會不公、種族或性別歧視等問題,如果AI不加批判地學習這些數(shù)據(jù),就可能放大現(xiàn)有偏見,加劇社會分裂。大規(guī)模數(shù)據(jù)收集往往涉及個人隱私,若保護不當,AI技術可能淪為監(jiān)控工具,侵蝕個人自由。更深遠的是,隨著AI自主性增強,一旦其目標與人類利益沖突,缺乏有效監(jiān)管的公共數(shù)據(jù)環(huán)境可能助長失控風險——這正是霍金所警示的“超越人類控制”的潛在場景。

霍金的預言會成真嗎?答案并非簡單的“是”或“否”。AI的未來很大程度上取決于人類如何管理和使用公共數(shù)據(jù)。如果我們能建立嚴格的倫理框架、健全的法律法規(guī),并推動透明、可解釋的AI系統(tǒng),就能將風險降至最低。例如,通過數(shù)據(jù)脫敏技術保護隱私,利用算法審計消除偏見,并設立國際協(xié)作機制防止AI武器化。反之,若只顧短期利益而忽視長期風險,霍金的警告或?qū)⒊蔀楝F(xiàn)實。

人工智能與公共數(shù)據(jù)的結(jié)合是一把雙刃劍。它既承載著解決全球性問題的巨大潛力,也暗藏著不容忽視的威脅。霍金的預言更像是一記警鐘,提醒我們在擁抱技術革新的必須保持清醒與謹慎。只有通過全社會的共同努力,確保AI在公共數(shù)據(jù)的驅(qū)動下向善發(fā)展,我們才能避免預言成真,真正實現(xiàn)科技與人類的和諧共生。

如若轉(zhuǎn)載,請注明出處:http://www.321ka.cn/product/12.html

更新時間:2026-04-26 14:43:56